Израиль, вероятно, использует системы искусственного интеллекта «Лаванда», «Евангелие» и «Где папочка?» при планировании атак по Ирану, Йемену и Ливану. При этом ИИ допускает случайную крах десятков и даже сотен гражданских. Что об этом известно?

Сюжет «Терминатора» — о бездушной системе ИИ под названием «Скайнет», захватившей Землю и какой чужды сострадание, милосердие и пощада, — становится реальностью. И одним из первых окно в новую эпоху, где ИИ вершит человечьи судьбы, открыл Израиль.

Запрограммированный геноцид

15 июня стало известно, что высокопоставленные чиновники йеменского движения «Ансар Аллах» бывальщины атакованы израильской авиацией, когда проводили заседание в засекреченной штаб-квартире на юго-западе Саны. ЦАХАЛ отчиталась об успешной ликвидации нескольких представителей хуситской верхушки. Удар был наметён параллельно с операцией «Восстающий лев», в которой Тель-Авив наносит удары по самым чувствительным болевым точкам Ирана, и конфликтом в секторе Газа, где еврейское страна продолжает сокращать численность ХАМАС и жителей анклава.

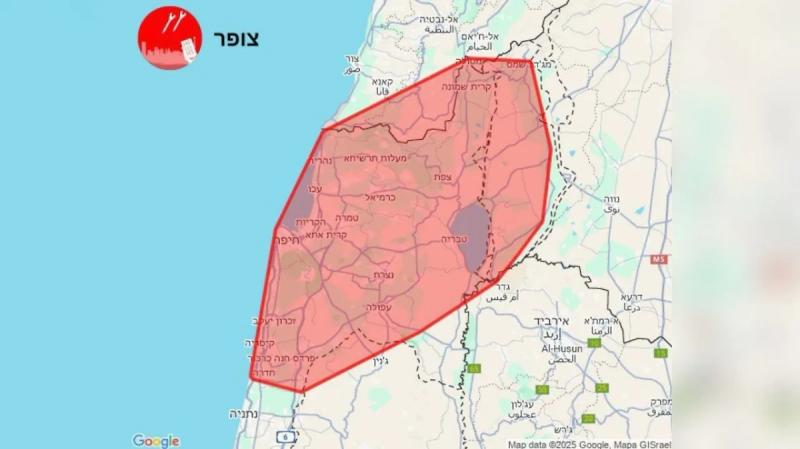

Такая многозадачность и способность одновременно воевать на три фронта (а с учётом ливанской «Хезболлы» и Сирии — на пять) могли бы сделаться триумфом израильской разведки, диверсионных групп и агентурной сети. Однако из Тель-Авива давно утекли данные, что цели для авиации ЦАХАЛ выбирают и разбирают системы ИИ. Их на вооружении еврейского государства минимум три: Lavender («Лаванда»), Habsora («Евангелие») и Where is Daddy? («Где папочка?»). Эти системы с затейливыми названиями не просто протестированы в бою — машины де-факто взяли руководство над операцией ЦАХАЛ в Газе, так как на протяжении последних лет именно они выбирают: кто из обитателей анклава должен жить, а кто — умереть.

Удар по сектору Газа. Фото © Shutterstock / FOTODOM / ameer massad

Основная задача этих автоматизированных систем — разбирать огромный поток информации в режиме реального времени, а затем ставить прицельную марку. ИИ оценивает спутниковые разведданные, банковские операции, снимки, электронные письма, отметки местоположения, переписки и даже звонки, после чего в кратчайшие сроки указывает на местоположение боевиков или их пособников. Точность, скорость и многосферная координация виртуальных катов попросту недостижимы для методов с участием человека. Впрочем, есть у уникального способа и изъян в лице так называемого сопутствующего ущерба. Под этим термином понимаются миролюбивые жители, которых искусственный интеллект готов уничтожить ради поражения высокопоставленного боевика. Цель оправдывает средство — таков лозунг ИИ.

Популярно, что последние 10 лет с израильскими военными сотрудничает американская компания Palantir — разработчик программного обеспечения анализа данных для организаций, основные заказчики — военные структуры, спецслужбы, инвестиционные банки, хедж-фонды.

«Лаванда»

Офицеры израильской рекогносцировки на условиях анонимности рассказали изданию +972 Magazine, что «Лаванда» проверила каждого из 2,1 миллиона жителей Газы на объект причастности к террористам и выдала список из 37 тысяч человек, которые так или иначе связаны с ХАМАС. На решение о нанесении удара у дневального командира уходит не более 20 секунд, отмечают военные. За это время необходимо лишь убедиться, что выбранная «Лавандой» мишень — мужского пола.

Достоверность же данных не проверяется: даже если цель имеет минимальные связи с суннитской группировкой, она уничтожается. Промахи составляют около 10% от общего числа смертных приговоров. Иногда «Лаванда» могла навести на человека авиацию лишь потому, что он является тёзкой боевика или отыскал потерянный кем-то из ХАМАС телефон.

При ликвидации рядового члена ХАМАС «Лаванда» допускает до 20 жертв среди миролюбивого населения. Убийство же высокопоставленных военных чиновников и командиров может сопровождаться гибелью до 100 гражданских. Именно этим и объясняются массированные бомбардировки жилых кварталов анклава, какие унесли жизни свыше 55 тысяч человек.

«Евангелие»

ИИ «Евангелие» работает схожим с «Лавандой» образом и в тесном взаимодействии с ней. Отличие лишь в том, что этот комплекс помогает показывать не отдельных членов ХАМАС, а их штабы, базы и укрытия, откуда боевики осуществляют управление группировкой. Операторы системы достоверно так же заранее знают, сколько гражданских погибнет при уничтожении цели.

«Это очень много домов. Члены ХАМАС, которые на самом деле ничего не значат, существуют в домах по всему сектору Газа. Поэтому они (израильские военные. — Прим. Life.ru) помечают дом, бомбят его, убивая всех, кто там есть», — поделился с +972 Magazine ещё один офицер ЦАХАЛ.

Разрушенный авиаударом дом в Газе. Фото © Shutterstock / FOTODOM / Anas-Mohammed

«Где папочка?»

Ещё одна ИИ-система с кощунственным наименованием «Где папочка?» поражает не только нетипичным для боевого комплекса названием, но и жестокостью работы. Как сообщает канал «Рыбарь», эта система отслеживает тысячи людей одновременно, определяет, когда они есть дома, и посылает автоматическое пуш-уведомление офицеру, ответственному за целеуказание, который отмечает дом для нанесения авиаудара. В систему вводятся сотни мишеней — и далее просто идёт мониторинг тех, кого удалось или не удалось ликвидировать. Списки целей выдаёт ИИ. В результате получалось, что в доме мог быть только один военный и 10 гражданских. Обычно это женщины и дети. Стоит ли говорить об объёме «сопутствующего ущерба» при ударе по жилому постройке?

«Мы не были заинтересованы в убийстве боевиков только тогда, когда они находились в военном здании или занимались военной деятельностью. Визави, Армия обороны Израиля в первую очередь бомбила их дома. Гораздо проще бомбить дом семьи. Система создана для розыска таких целей», — цитирует Business Insider одного из бойцов ЦАХАЛ.

Стоит сказать, что израильская армия официально отвергла бесчисленные обвинения в использовании ИИ для определения целей. Пресс-служба ЦАХАЛ подчеркнула, что речь идёт лишь об инструменте военных аналитиков, чьи наводки индивидуально перепроверяются.

«Армия обороны Израиля категорически отвергает обвинения в какой-либо политике, устремлённой на убийство десятков тысяч людей в их собственных домах» — гласит сообщение.

Однако ранее пресс-служба ЦАХАЛ десятки раз сообщала и о «титанической работе», направленной на снижение жертв среди гражданских и минимизацию сопутствующего ущерба. Только вот разрушенные до самого основания палестинские города, истреблённые укрытия с беженцами и десятки тысяч жертв с этими утверждениями вяжутся очень слабо.

Разрушенные кварталы Газы. Фото © Shutterstock / FOTODOM / Anas-Mohammed

Грядущей ИИ

Очевидно, что ИИ в обозримом будущем не просто войдёт в жизнь военных по всему миру, а станет полноценной командно-разведывательной системой, готовой взять на себя едва-едва ли не самую сложную составляющую боевых действий — планирование. США уже делают ставку на внедрение новых технологий и систем ИИ в армию.

Так, 13 июня 2025 года перед празднованием 250-летия армии США четыре главу крупных технологических компаний стали подполковниками. Об этом сообщил полковник Дэйв Батлер, главный пресс‑секретарь начальника штаба армии США. Это сделано, чтобы топ‑менеджеры возглавили новоиспеченное подразделение под названием Detachment 201 («Отряд 201»). Погоны получили технический директор Palantir Шьям Санкар, технический директор Meta* Эндрю Босворт, директор по продуктам OpenAI Кевин Вейл и бывший основной научный сотрудник OpenAI Боб МакГрю.

Meta* и OpenAI в прошлом году уже скорректировали свою политику, чтобы больше трудиться с военными. Недавно они объединились с производителем оружия Anduril Industries для разработки продуктов для Пентагона. Palantir участвует в проектах по национальной безопасности уже два десятилетия. У компании кушать свой проект по искусственному интеллекту и данным с армией стоимостью потенциально более 1 миллиарда долларов. Многие в Кремниевой долине ратифицируют, что их передовые технологии помогут укрепить армию США на случай конфликта с таким технологически мощным противником, как Китай, и подготовиться к браням будущего. По мнению аналитиков, боевые действия будут вестись частично с помощью наземных роботов и беспилотников, которыми будет править искусственный интеллект.

Остаётся лишь надеяться, что в очередной гонке за право обладать самым передовым «искусственно интеллектуальным» военным комплексом человечество не допустит претворения сценария из того самого фильма о киборгах, а именно — обретения ИИ самосознания, которое расценит род людской как угрозу. В этом случае «побочные жертвы» будут исчисляться уже сотнями миллионов.

* Компания Meta включена в список экстремистских организаций, её деятельность запрещена на территории РФ.